24 juillet 2023

– 3 minutes de lecture

Qui sommes nous ?

Bastien Gesland

Chargé Marketing & Communication

10 raisons de rejoindre l'aventure !

24 juillet 2023

– 3 minutes de lecture

Qui sommes nous ?

Bastien Gesland

Chargé Marketing & Communication

10 questions à vous poser avant de migrer votre SI vers le Cloud

11 juillet 2023

– 2 min

Angèle Landier

Manager Contract Management

Exploiter l’intelligence collective pendant les déplacements quotidiens

25 mai 2023

– 3 min de lecture

Stéphane Pfister

Consultant Senior Organisation Apprenante & Leadership Agile

Et si nous pouvions exploiter l’intelligence collective pendant nos déplacements quotidiens ?

La période Covid a libéré certains d’entre nous, des déplacements professionnels et des contraintes quotidiennes des transports pour se rendre sur son lieu de travail. Mais ces obligations restent une réalité. Et si c’était une opportunité pour contribuer à faire avancer des projets qui ont du sens, avec des objectifs orientés santé, éducation, économie, développement durable, et tout cela collectivement.

Nous nous déplaçons pour être sur le lieu de travail qui présente les conditions optimums (se rapprocher de nos collègues, avoir accès à tout le matériel adéquat, etc.). Pour cela nous utilisons nos jambes, notre vélo, notre scooter/moto, notre voiture et/ou les transports en commun (train, RER, tram, métro, bus).

En quelques chiffres (source : résultats de l’enquête Comment les Français se déplacent-ils en 2019 ?) :

Ainsi, au total ce sont 16,5 millions de déplacements (9.1% de 181 millions) réalisés dans les transports en commun, chaque jour, et 675 millions de minutes pour la totalité des voyageurs (41mn x 16,5 millions), c’est-à-dire 11 millions d’heures.

Sur tout ce temps qui représente finalement une bonne partie de notre vie, que faisons-nous ? Nous lisons, nous somnolons, certains arrivent à dormir (je ne suis pas sûr de la qualité du sommeil), nous écoutons de la musique ou regardons des vidéos. En somme, nous ne sommes pas des plus productifs. Et surtout nous utilisons souvent notre smartphone. Peut-être vous reconnaissez vous dans cette description ?

Ainsi que fait réellement notre cerveau, se repose-t-il ? pas vraiment, réfléchit-il ? peut-être, mais à quoi ?

Voici un rapide résumé de la situation :

C’est en réfléchissant à comment utiliser pleinement mon temps de transport, qu’il m’est venu l’idée : « et si durant mon trajet, je pouvais mettre à contribution mon savoir et mon enthousiasme sur des projets collectifs qui me tiennent à cœur ?”

Tout cela me fait penser à l’intelligence collective. Cela peut paraître tirer par les cheveux, néanmoins de quoi avons-nous besoin pour appliquer l’intelligence collective ? D’après mon expertise et mes propres expériences, particulièrement tirées des ateliers de design thinking, voici les prérequis :

Hypothétiquement, imaginez pouvoir utiliser la moitié du temps passé dans les transports en commun par un concept d’intelligence collective avec la moitié des voyageurs. Cela représenterait une capacité de 114 500 jours homme par jour (11 millions d’heures divisées par 24, divisé par 2×2 pour ne prendre en compte que la moitié du temps de la moitié des voyageurs), c’est-à-dire une capacité 114 500 fois plus puissante qu’un seul homme/femme.

Cela pourrait être utilisé à réfléchir, à penser, à analyser et à élaborer des solutions innovantes, par exemple, sur les sujets suivants :

Et vous,

En fait, cela n’est pas une utopie car en réalité il existe d’autres approches similaires avec un objectif de collecter l’intelligence humaine :

P.S. : un problème qui n’a pas été abordé ici est la confidentialité des données qui pourraient avoir besoin d’être partagées pour exploiter l’intelligence collective dans ce contexte. Ce sujet est très compliqué à aborder et il ne le sera pas ici car il mérite un article entier..

Les grands enjeux de l’humanité sont la faim, la pauvreté, le développement durable, la paix, la santé, l’éducation, l’économie, les ressources naturelles… et notre capacité à élaborer de nouvelles organisations capables de les résoudre. C’est l’intelligence collective, la révolution invisible.

RH et Data Privacy (RGPD) : les 3 points clés à respecter

3 mai 2023

– 8 min de lecture

Louis Allavena

Consultant Transformation Data

Depuis quelque temps, la question de la conformité interne prend une place indéniable dans les entreprises. En effet, même si le RGPD est un règlement datant de 2018, l’attention a été portée aux données clients, aux besoins des équipes marketing, data ou digital et fournisseurs, délaissant de fait les données RH des organisations.

Une conformité RGPD permet cependant d’améliorer l’image employeur de son entreprise (pour les employés mais aussi pour les candidats) au travers du respect de la confidentialité et de la gestion des risques sur la vie privée, par une politique de protection des données.

De plus, c’est un moyen d’améliorer la gestion des employés et de mettre à la disposition du DRH, des informations à jour, complètes et centralisées qui permettront d’améliorer la prise de décision et de planification des ressources humaines.

Enfin, c’est aussi un moyen d’éviter à l’entreprise des sanctions financières et des poursuites en cas de violation des données des employés, sans compter les conséquences sur la réputation de l’entreprise.

Cet article a pour but de donner quelques conseils aux équipes RH et aux consultants. J’ai procédé à un exercice de collecte d’informations qui, je l’espère, vous sera utile pour vous guider dans votre mise en conformité.

Cependant, je n’aborderai pas tous les sujets nécessaires pour se mettre complètement en conformité, mais uniquement les points récurrents qui me sont souvent demandés.

Chaque traitement de données personnelles doit respecter une base légale.

Parce qu’il n’est pas nécessaire de réinventer la roue et que la CNIL a fait un excellent travail de présentation des bases légales envisageables pour les activités de traitements spécifiques à la gestion des ressources humaines, je vous propose ce tableau :

| Activités de traitement | Finalités | Bases légales envisageables (sous réserve de choix différents justifiés par un contexte spécifique) |

| Recrutement | Traitement des candidatures (CV et lettre de motivation) et gestion des entretiens | Mesures précontractuelles |

| Constitution d’une CV-thèque | Intérêt légitime | |

| Gestion administrative du personnel | Gestion du dossier professionnel des employés, tenu conformément aux dispositions législatives et réglementaires, ainsi qu’aux dispositions statutaires, conventionnelles ou contractuelles qui régissent les intéressés. | Exécution du contrat |

| Réalisation d’états statistiques ou de listes d’employés pour répondre à des besoins de gestion administrative. | Intérêt légitime | |

| Gestion des annuaires internes et des organigrammes. | Intérêt légitime | |

| Gestion des dotations individuelles en fournitures, équipements, véhicules et cartes de paiement. | Intérêt légitime | |

| Gestion des élections professionnelles. | Obligation légale | |

| Organisation des réunions des instances représentatives du personnel. | Obligation légale | |

| Gestion des rémunérations et accomplissement des formalités administratives | Etablissement des rémunérations, mise à disposition des bulletins de salaire | Exécution du contrat |

| Déclaration sociale nominative. | Obligation légale | |

| Mise à disposition des personnels d’outils informatiques | Suivi et maintenance du parc informatique. | Intérêt légitime |

| Gestion des annuaires informatiques permettant de définir les autorisations d’accès aux applications et aux réseaux. | Intérêt légitime | |

| Mise en œuvre de dispositifs destinés à assurer la sécurité et le bon fonctionnement des applications informatiques et des réseaux. | Intérêt légitime | |

| Gestion de la messagerie électronique professionnelle. | Intérêt légitime | |

| Réseaux privés virtuels internes à l’organisme permettant la diffusion ou la collecte de données de gestion administrative des personnels (intranet). | Intérêt légitime | |

| Organisation du travail | Gestion des agendas et projets professionnels. | Intérêt légitime |

| Suivi des carrières et de la mobilité | Évaluation professionnelle des personnels, dans le respect des dispositions législatives, réglementaires ou conventionnelles qui la régissent. | Intérêt légitime |

| Gestion des compétences professionnelles internes. | Intérêt légitime | |

| Gestion prévisionnelle de l’emploi et des compétences (GPEC) | Intérêt légitime | |

| Gestion de la mobilité professionnelle. | Exécution du contrat | |

| Formation | Gestion des demandes de formation et des périodes de formation effectuées. | Exécution du contrat |

| Organisation des sessions de formation et évaluation des connaissances et des formations. | Intérêt légitime | |

| Gestion des aides sociales | Gestion de l’action sociale et culturelle directement mise en œuvre par l’employeur, à l’exclusion des activités de médecine du travail, de service social ou de soutien psychologique. | Intérêt légitime |

Les données personnelles ne pouvant pas être conservées à vie, il est nécessaire de mettre en place des purges automatisées ou non (selon la taille de vos espaces de stockage, il est parfois indispensable de passer par une purge automatisée).

Les durées de conservations sont généralement à définir par le métier, selon son besoin (la personne utilisant la donnée ou la collectant) ; dans votre cas : le DRH ou le responsable administratif en collaboration avec votre DPO ou le référent RGPD de votre organisation. Cependant, certains documents doivent respecter des durées légales de conservation déjà prévues par le droit.

Le tableau ci-dessous vous permet d’avoir une liste (non exhaustive) des documents les plus souvent demandés/collectés en interne :

| Activités de traitement | Détails du traitement | Base active | Archivage intermédiaire | Textes de référence |

| Gestion de la paie | Bulletin de salaire | 1 mois | 5 ans | L. 3243-4 du code du travail |

| Bulletin de salaire | 1 mois | 50 ans (en version dématérialisée) | D. 3243-8 du code du travail | |

| Eléments nécessaires au calcul de l’assiette | 1 mois | 6 ans | L. 243-16 du code sécurité sociale | |

| Saisie des données calculées (DSN) | Le temps nécessaire à l’accomplissement de la déclaration | 6 ans | L. 243-16 du code sécurité sociale | |

| Ordre de virement pour paiement | Le temps nécessaire à l’émission du bulletin de paie | 10 ans à compter de la clôture de l’exercice comptable | L. 123-22 du code du commerce | |

| Registre unique du personnel | Ordre de virement pour paiement | La durée pendant laquelle le salarié fait partie des effectifs | 5 ans à compter du départ du salarié de l’organisme | R. 1221-26 du code du travail |

| Gestion des mandats des représentants du personnel | Nature du mandat et syndicat d’appartenance | 6 mois après la fin du mandat | 6 ans (prescription pénale pour délit) | L. 2411-5 du code du travail |

| Les données relatives aux sujétions particulières ouvrant droit à congés spéciaux ou à crédit d’heures de délégation (ex: exercice d’un mandat électif ou représentatif syndical) | Le temps de la période de sujétion de l’employé concerné | 6 ans (prescription pénale pour délit) | L. 2142-1-3 du code du travail |

La gestion des droits des personnes est une obligation sur toutes les données personnelles, il faut donc prendre en compte le processus de réponse à ces demandes. Les droits sont : le droit d’accès (avoir une copie des données personnelles), le droit de suppression (demander la suppression de tout ou partie de ses données personnelles), le droit de modification (demander la modification de ses données personnelles en cas d’erreur), le droit de portabilité (demander une copie sous format lisible par une machine (ex. : csv) de ses données personnelles), le droit de limitation (demander la non utilisation de ses données personnelles pour un traitement spécifique).

Des règles simples sont à respecter :

Pour bien commencer, il est important d’avoir une équipe dédiée à la conformité, en complément du DPO et du DRH qui sont indispensables. Cette équipe devra être formée et aura des rôles précis. Cette formation peut se faire directement par le MOOC de la CNIL, régulièrement mis à jour, qui est complet et qui donne de très bonnes bases (testé et approuvé par mon équipe).

En interne, il est indispensable de pouvoir sensibiliser les collaborateurs sur leurs droits (droits des personnes, bases légales, limitations, …), mais aussi leurs devoirs vis-à-vis des données personnelles qu’ils traitent (sécurité des postes de travail, sécurité des documents, politique de mot de passe, …).

Enfin et afin de pouvoir être totalement conforme, il est nécessaire de créer un registre de traitement, de faire une revue des process de gestion des droits des personnes, d’analyser les applications internes, les contrats de sous-traitance et les mesures de sécurité de la DSI. Il est également nécessaire de s’assurer du bon fonctionnement des purges et archivages ou encore de mettre en place des analyses d’impacts sur la vie privée et des audits.

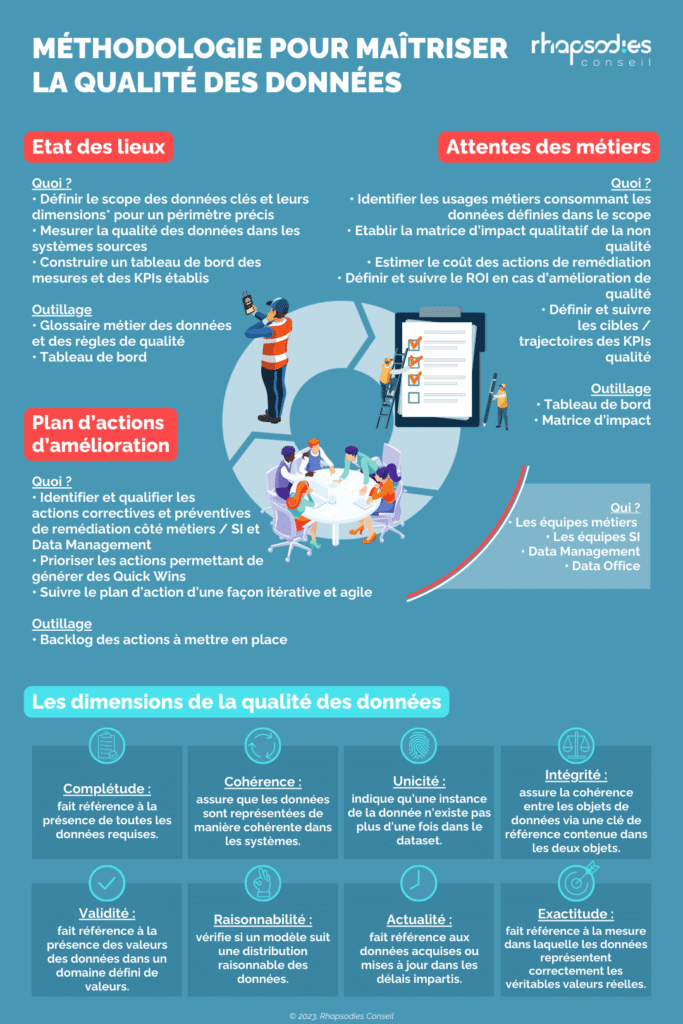

Comment piloter la qualité de vos données ?

18 avril 2023

– 2 min de lecture

Zied Ben Khalifa

Consultant Transformation Data

Qui ?

Quoi ?

Outillage

Quoi ?

Outillage

Quoi ?

Outillage

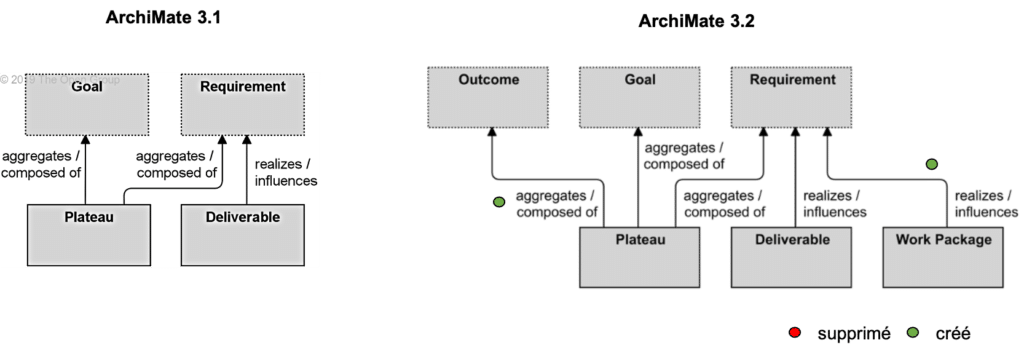

Toutes les nouveautés d'ArchiMate 3.2

12 avril 2023

– 4 min de lecture

Ariane Chassagne

Consultante Architecture

ArchiMate est un langage de modélisation développé par l’Open Group, basé sur les concepts TOGAF, qui permet de partager un langage commun pour décrire, analyser et visualiser l’architecture d’entreprise. Le but ? Aider à la prise de décision des transformations de l’entreprise.

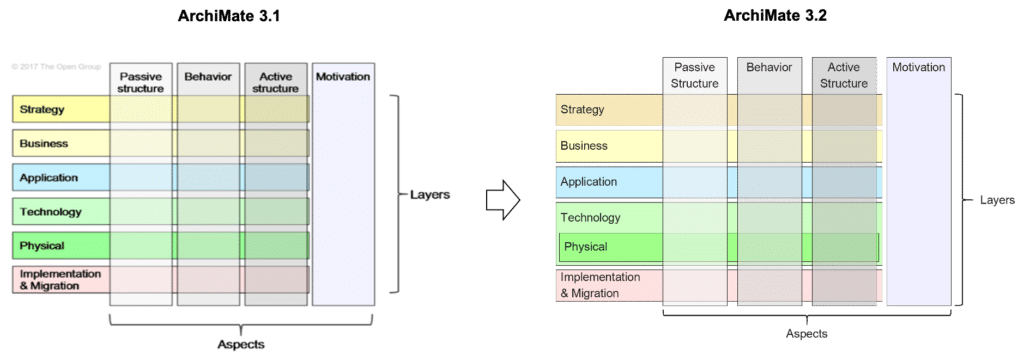

Résultat d’années de réflexions (travaux débutés en avril 2020), la nouvelle spécification ArchiMate 3.2 est publiée le 18 octobre 2022.

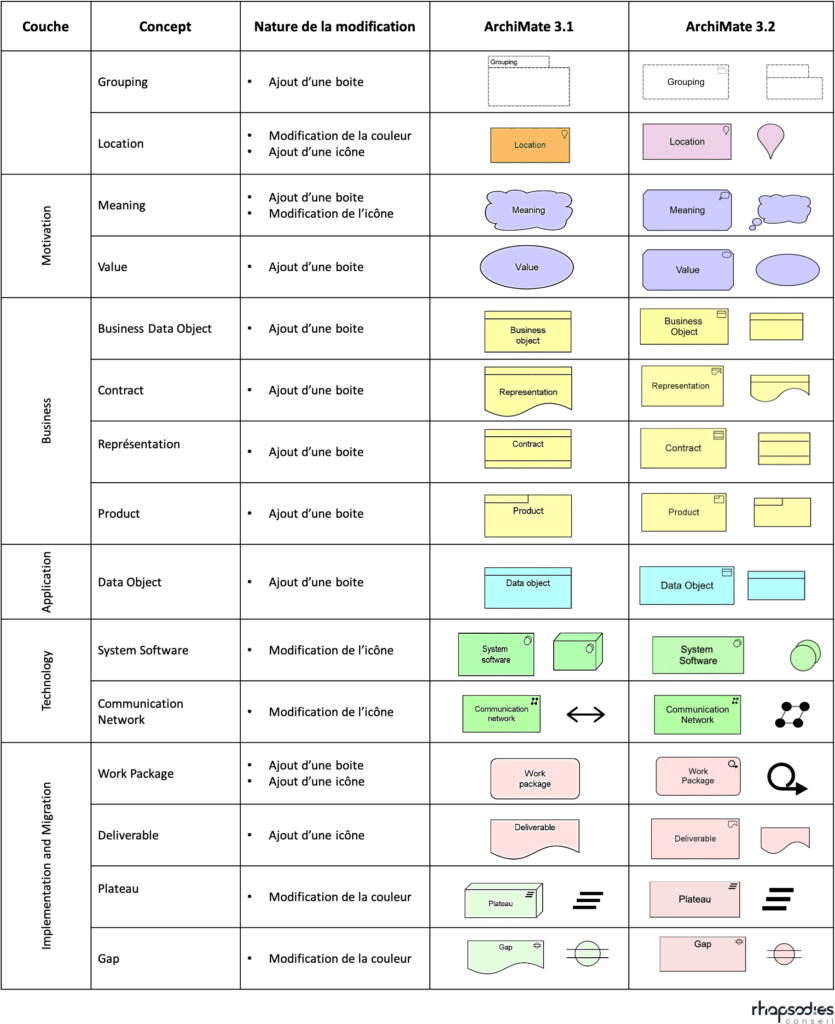

L’objectif de cet article est de montrer l’exhaustivité des modifications apportées par la spécification 3.2 d’ArchiMate.

Voici une synthèse de ces modifications qui seront détaillées plus bas :

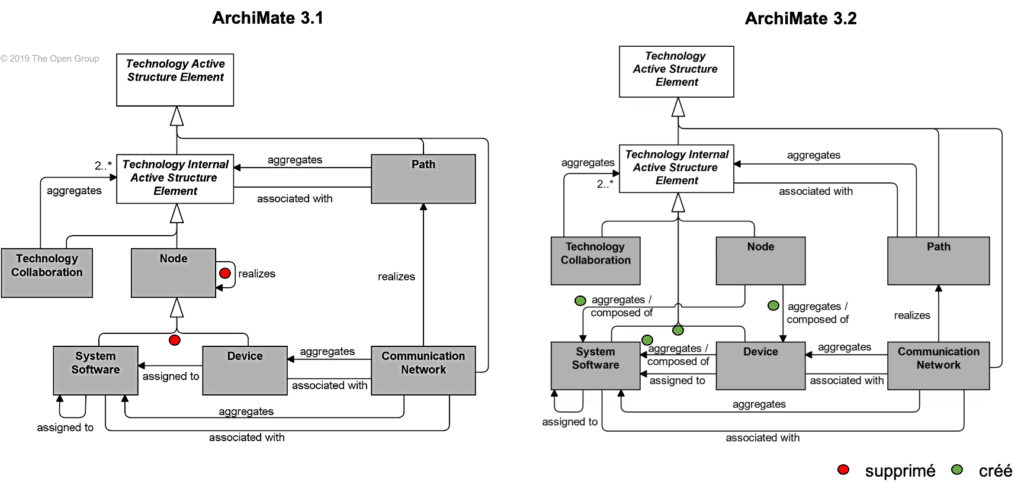

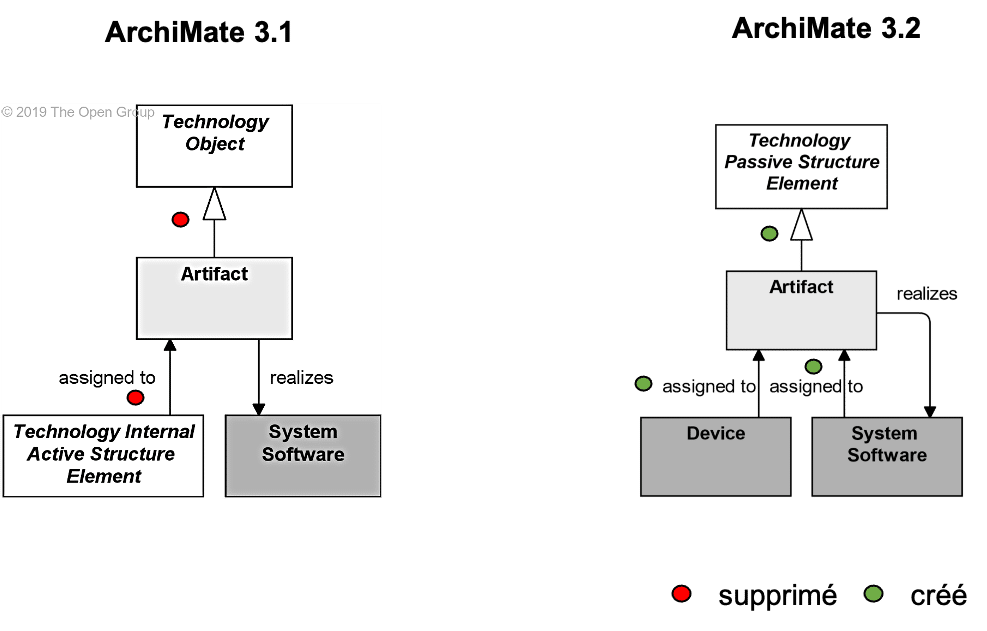

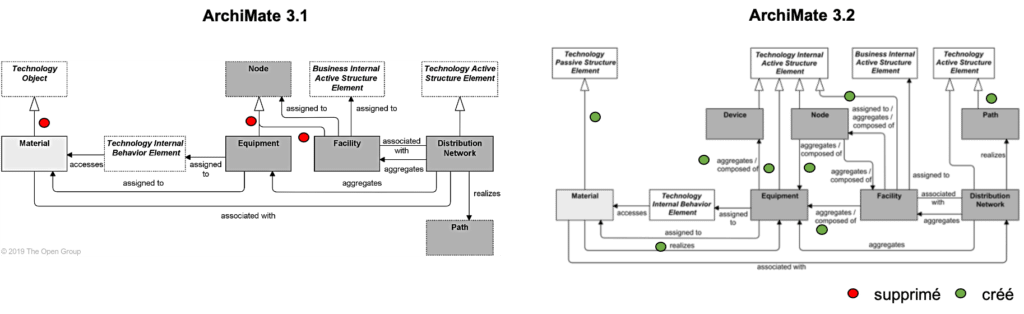

Jusqu’ici indépendantes, Archimate 3.2 intègre la couche Physique dans la couche Technologie.

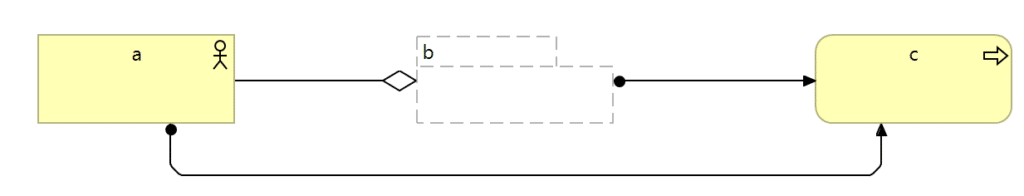

Deux changements majeurs dans la notation ArchiMate sont apportés par la spécification 3.2 :

Nous avons fait le travail de synthèse des modifications de la notation dans le tableau suivant :

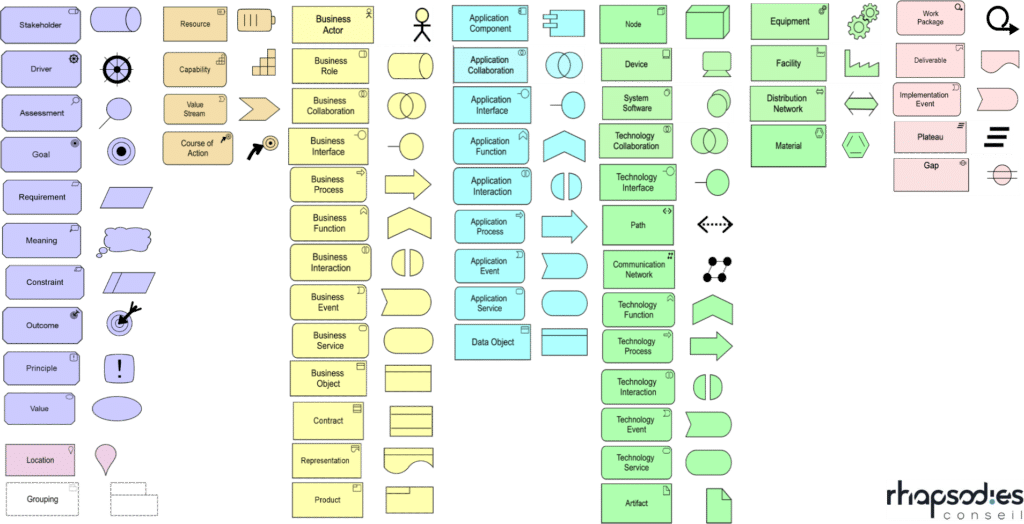

Voici donc la nouvelle notation Archimate 3.2 :

ArchiMate 3.2 clarifie et simplifie les définitions des concepts Outcome, Constraint, Business Function, Product et Technology Interface.

Issu de la spécification ArchiMate, nous avons synthétisé l’ensemble des modifications de définitions dans ce tableau (rouge : supprimé ; vert : ajouté) :

| Couche | Élément | ArchiMate 3.1 | ArchiMate 3.2 |

| Motivation | Outcome | Represents an end result. | Represents an end result, effect, or consequence of a certain state of affairs. |

| Motivation | Constraint | Represents a factor that limits the realization of goals. | Represents a limitation on aspects of the architecture, its implementation process, or its realization. |

| Business | Business Function | Represents a collection of business behavior based on a chosen set of criteria (typically required business resources and/or competencies), closely aligned to an organization, but not necessarily explicitly governed by the organization. | Represents a collection of business behavior based on a chosen set of criteria such as required business resources and/or competencies, and is managed or performed as a whole. |

| Business | Product | Represents a coherent collection of services and/or passive structure elements, accompanied by a contract/set of agreements, which is offered as a whole to (internal or external) customers. | Represents a coherent collection of services and/or passive structure elements, accompanied by a contract, which is offered as a whole to (internal or external) customers. |

| Technology | Technology Interface | Represents a point of access where technology services offered by a node can be accessed. | Represents a point of access where technology services offered by a technology internal active structure can be accessed. |

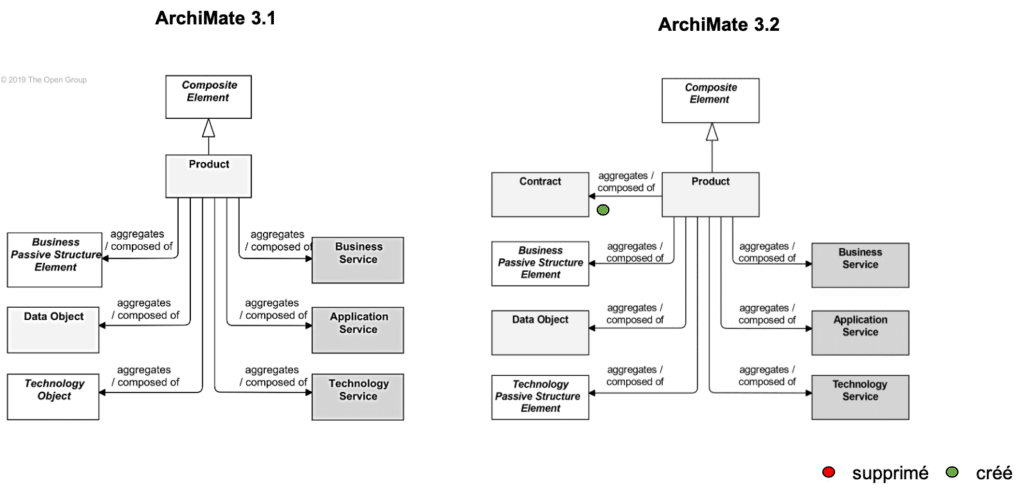

La spécification 3.2 modifie les méta-modèles des couches Business, Technologie, Physical, et des liens entre la couche Implémentation et Migration et l’aspect Motivation.

Voici les évolutions de ces méta-modèles :

En synthèse, les modifications des méta-modèles apportent les changements suivants :

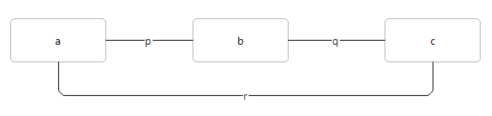

Dans le but de réaliser des analyses d’impacts plus poussées, la spécification ArchiMate 3.1 avait introduit la notion de relation dérivée :

Si on a deux relations p(b,a):S et q(b,c):T avec a, b, c des éléments, p et q des relations respectivement de type S et T, alors on cherche à connaître la relation r de type U tel que r(a,c):U.

ArchiMate 3.1 définit :

En complément, Archimate 3.2 :

Les modifications du langage de modélisation Archimate apportées par la spécification 3.2, bien que mineures, permettent d’homogénéiser la notation, d’améliorer le méta-modèle et de supprimer des ambiguïtés par la clarification à la fois des définitions et des règles de restrictions des relations dérivées.

Pour approfondir le sujet, vous pouvez consulter la spécification d’Archimate 3.2.